AI 技術がますます成熟し、多くの分野に応用されるようになるにつれて、 AI がどのように意思決定を行うかについての懸念が高まっています。

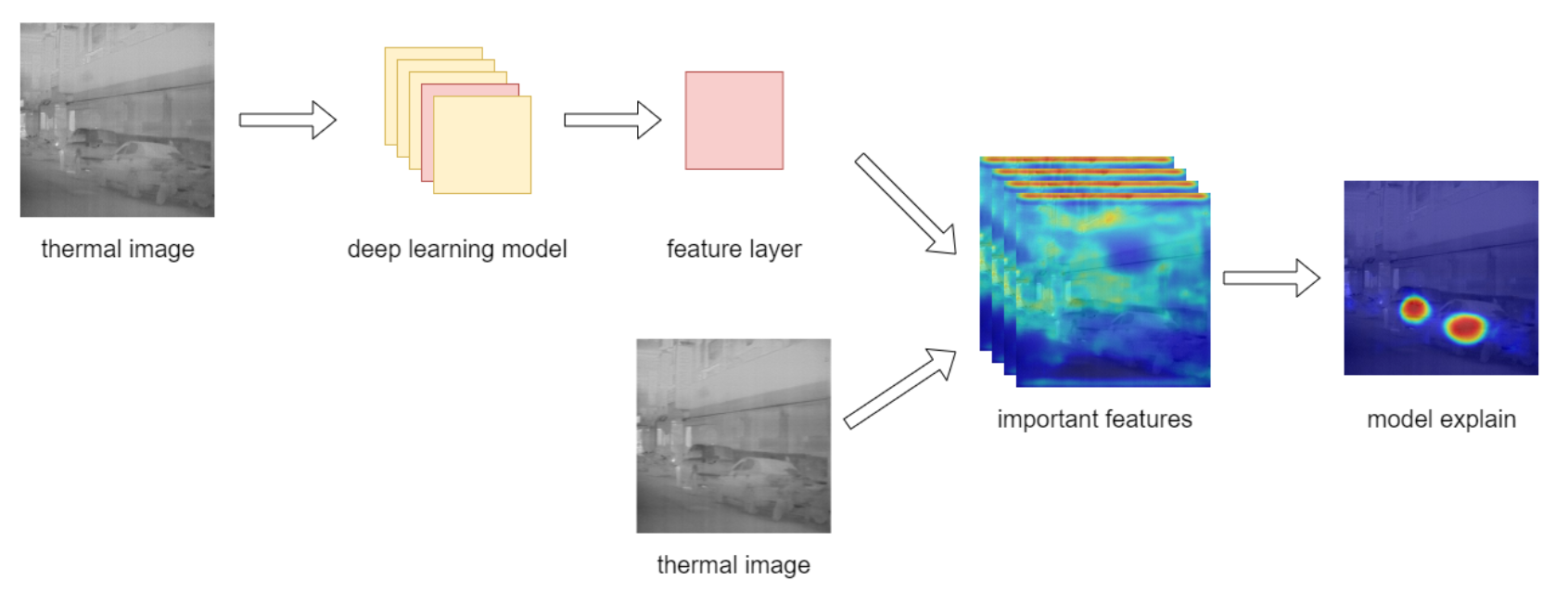

車載エレクトロニクス業界は、とりわけ厳密な定義が求められる分野です。AIを自動車分野に適用する場合、AIの意思決定プロセスが合理的であることが重要です。AIの精度をデータ検証で確認するだけではなく、AIが正しい特徴を学習したことを確認するためのモデル解釈も必要です。そこで、当社は物体認識モデルが適切な特徴を学習しているかを検証するモデル解釈手法を開発しました。

当社でのモデル解釈の活用例:

1. モデルの特性およびモデル解釈手法に基づき、モデルが適切な特徴を学習したかどうかを評価する指標を策定しました。この指標に基づいてデータ収集方針を調整できます。たとえば、モデルが苦手な複雑シナリオで学習データの不足が判明した場合は、該当データを追加収集して学習を改善します。

2. モデル解釈を用いてカテゴリ間の類似度を算出し、モデルが類似度の高い対象物を混同していないかどうかを確認します。

3. 実環境でカメラの取り付け位置や角度がわずかに変化した場合のシナリオをシミュレーションし、モデル解釈を用いてモデルが学習した特徴を観察します。これによりAIモデルのロバスト性を検証し、実運用においても引き続き精度を維持できることを確認します。

結果